智能集市概述¶

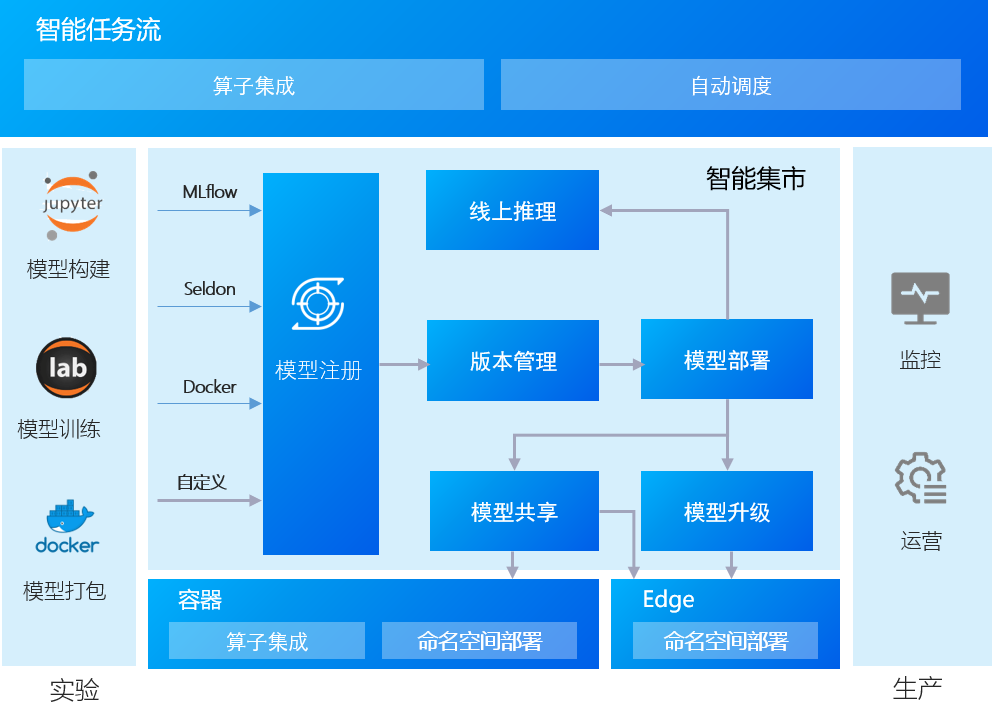

智能集市(MI Hub)为智能模型的使用者和数据科学家提供智能资产的集散中心,为模型开发者提供全面的模型注册流程和托管服务。

当一个模型从智能实验室中开发完成,或者是在第三方的系统中开发完成后,模型开发者需要将其部署到生产环境中执行预测任务。基于用户模型更新的需求,用户可以通过金丝雀部署、蓝绿部署的方式将多个模型同时部署到生产环境中。智能集市为模型开发者提供科学有效的版本管理工具,并可以在安全可控的环境中分享给终端用户和其他协作者,同时也可复用其他协同开发人员的智能资产。

产品架构¶

通过智能集市上架和部署机器学习模型的流程如下图所示:

主要功能

ML模型注册

基础信息注册:智能集市提供了引导式的模型注册流程,数据科学家或模型开发者可对模型按技术归属、类目、输入数据类型、应用领域等进行归类注册。

模型数据输入输出设置:支持标准化模型数据输入输出设置。

ML模型部署

支持主流的算法模型计算框架,包括 Tensorflow、Pytorch、Sklearn、Spark、H2o。

支持与计算框架匹配的协处理器。

支持部署不同编程语言的算法模型,目前支持 Java 和 Python。

提供可视化的部署画布,支持蓝绿部署和金丝雀部署模式,将模型部署到指定资源池。

支持云端部署和边缘部署模型

ML模型版本管理

支持多种模型构建方式,包括通过 MLflow 导入、容器镜像文件导入、Seldon core 方式导入、自定义第三方导入。

支持同一模型上架多个版本,以便于模型在线迭代。

支持对模型的版本进行测试,帮助确保每一个上线的版本都可用。

ML模型的安全协作

智能集市提供安全可控的环境,对于以公有模式注册的模型,支持协作开发。

ML模型生命周期管理

支持对模型版本进行升级、退役、再利用、删除等操作。

样例模型

提供了多个通用的典型ML模型,帮助用户熟悉各类算法和应用。

资源准备¶

ML模型-容器计算资源

使用智能集市注册和部署模型前,需确保OU已经通过 EnOS 管理控制台 > 资源管理 页面申请 ML模型-容器计算 资源的 子分区 资源模式。有关申请 ML模型-容器计算 资源的详细信息,参见 容器计算资源规格说明。

使用说明¶

ML模型可用性

模型开发者需确保开发的模型可用,并在注册模型时定义标准的特征输入和目标输出参数。